- read.me

- Posts

- Perché è tutto cosi veloce?

Perché è tutto cosi veloce?

Sulla velocità, la GenAI e le notizie a cui non si riesce a stare dietro

Ciao! Ri-eccoci su readme!

Settima settimana, e come sempre, grazie!

Readme è un progetto gratuito, ma comunque prende del tempo e delle energie. Se vuoi supportarmi, ti chiedo una piccola azione: inoltra questa mail, oppure gira il link su Whatsapp 🤩

Sulla velocità

Scrivo la mail di questa settimana di domenica notte, un po’ perché non ho trovato il tempo di farlo prima, un po’ perché proprio negli ultimi due giorni sono accaduti degli eventi che hanno stimolato una riflessione.

Una riflessione sulla velocità.

Stiamo andando troppo veloci?

Partiamo dalla notizia bomba (del mondo tech) degli ultimi giorni: Sam Altman, il CEO di OpenAI, l’azienda che ha lanciato ChatGPT, è stato licenziato.

La news ha colto tutti di sorpresa, compresi gli investitori di OpenAI, come Microsoft.

Ma la cosa che mi ha colpito non è tanto la notizia di licenziamento in sé, quanto la dinamica che ha portato a tale decisione. Per questo però dobbiamo riavvolgere un po’ il nastro del tempo e capire come sia nata OpenAI.

Rewind

OpenAI nasce nel 2015 come una no-profit, finanziata da una coorte di imprenditori del mondo tech come Elon Musk (non penso abbia bisogno di presentazioni), Reid Hoffmann (CEO di LinkedIn), Peter Thiel (uno dei più influenti investitori americani) e gente così.

L’obiettivo? Riunire le migliori menti del mondo per sviluppare un’AGI - Artificial General Intelligence - ossia una forma di intelligenza artificiale capace di affrontare task intellettuali come una mente umana.

Perché una no-profit? Sostanzialmente perché i fondatori vedevano un rischio nel mettere una tecnologia del genere nella mani di uno/ o pochi grandi gruppi tecnologici, per le potenziali conseguenze monopolistiche (e qui forse ci avevano giusto, se pensiamo agli attuali processi in corso a Google ed Amazon, ne avevamo parlato nelle puntate precedenti di readme).

Insomma: OpenAI svolgeva ricerca in modo aperto e trasparente, condividendo i propri risultati in modo open source.

E poi? Come siamo arrivati qui?

In breve: sviluppare soluzioni di AI costa moltissimo. Servono talenti incredibili, una mole di dati spaventosa, e soprattutto una capacità computazionale senza precedenti per poter allenare i modelli. Una no-profit può far fronte a tali spese solo con donazioni o con il patrimonio conferito. Insomma, non sarebbe stato possibile, non con le tempistiche e le ambizioni necessarie.

Nel 2019, OpenAI è diventata una società a scopo di lucro, con una struttura di governance insolita (e questo però è fondamentale) che limita i profitti degli investitori a un determinato multiplo del loro investimento, tenendo la no-profit (e l’organo decisionale della no-profit) a capo delle operazioni di tutta la struttura, inclusa quella commerciale. Uno screenshot dal sito di OpenAI aiuta a capire:

Questa struttura ha permesso di raccogliere un sacco di soldi da investitori (come Microsoft) e supportare la crescita fino a oggi.

Ma è la stessa struttura ad aver permesso al board della No-profit di licenziare il CEO Sam Altman, in modo relativamente arbitrario. Qui un articolo di Wired che spiega bene la dinamica.

Fast forward a oggi, domenica sera. Quello che mi chiedo è: come è possibile che 4 persone siano riuscite in soli due giorni a impattare in modo così definito la principale realtà AI al mondo?

Le motivazioni del licenziamento vanno trovate nell’opacità del CEO Altman rispetto al board. Una formula che è stata giudicata molto generica e opaca anche dal New York Times.

Come titola il NYT dobbiamo piuttosto cercare le ragioni nella paura. Perché l’AI ha dimostrato di cosa può essere capace la tecnologia (e a oggi siamo solo all’inizio), con conseguenze anche potenzialmente negative per la collettività.

La domanda chiave di tutta questa questione è: stiamo andando troppo veloci? Stiamo valutando anche i rischi? Stiamo capendo le conseguenze di questi strumenti?

E se penso al mio piccolo, quale può essere il risvolto personale di questa domanda? mi sto informando a sufficienza? Sto pienamente capendo gli usi di questa tecnologia?

Non ho una risposta chiara, come credo non ci sia mai stata nella storia. L’AI è stata paragonata all’elettricità quale tecnologia capace di trasformare radicalmente il nostro sistema tecnologico e sociale.

Quello che ho fatto è provare allora a cercare di approfondire anche i rischi e la normazione dell’AI.

Qui una shortlist di quanto ho trovato più interessante, sperando che sia utile anche per voi:

L’intervista di Obama a The Vergecast sul futuro dell’AI

La ricerca del Center for AI Safety, una no profit USA dedicata alla ricerca di modalità per lo sviluppo sicuro ed etico dell’AI

L’analisi del centro Stanford HAI sull’executive order statunitense in materia di regolazione AI:

Bonus

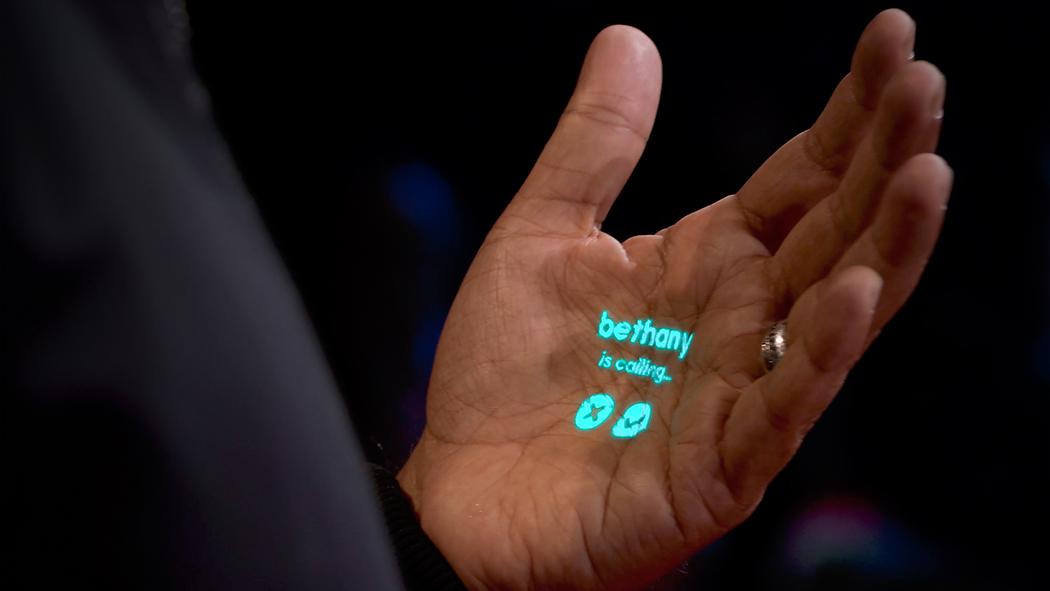

Il TED di Imran Chaudhri sul nuovo dispositivo AI Pin (ve ne avevo parlato la scorsa volta): e se ripensassimo agli oggetti tecnologici per sfruttare al meglio l’AI?

Avete finito i podcast da sentire? (beati voi!) Ho provato podcastai, con puntate generate solo dall’AI. Ci sono dialoghi assurdi (come Joe Rogan con Steve Jobs). Mi ha colpito la fluidità del discorso, e ovviamente la qualità delle voci.

And that’s all folks! Appuntamento a prossima settimana.

Se ti è piaciuta questa mail, condividila con la tua rete!